Cuando pensamos en inteligencia artificial imaginamos robots, asistentes virtuales o modelos que escriben código. La escena es futurista. Pero debajo de esa capa visible hay algo mucho menos espectacular y mucho más decisivo: matemáticas.

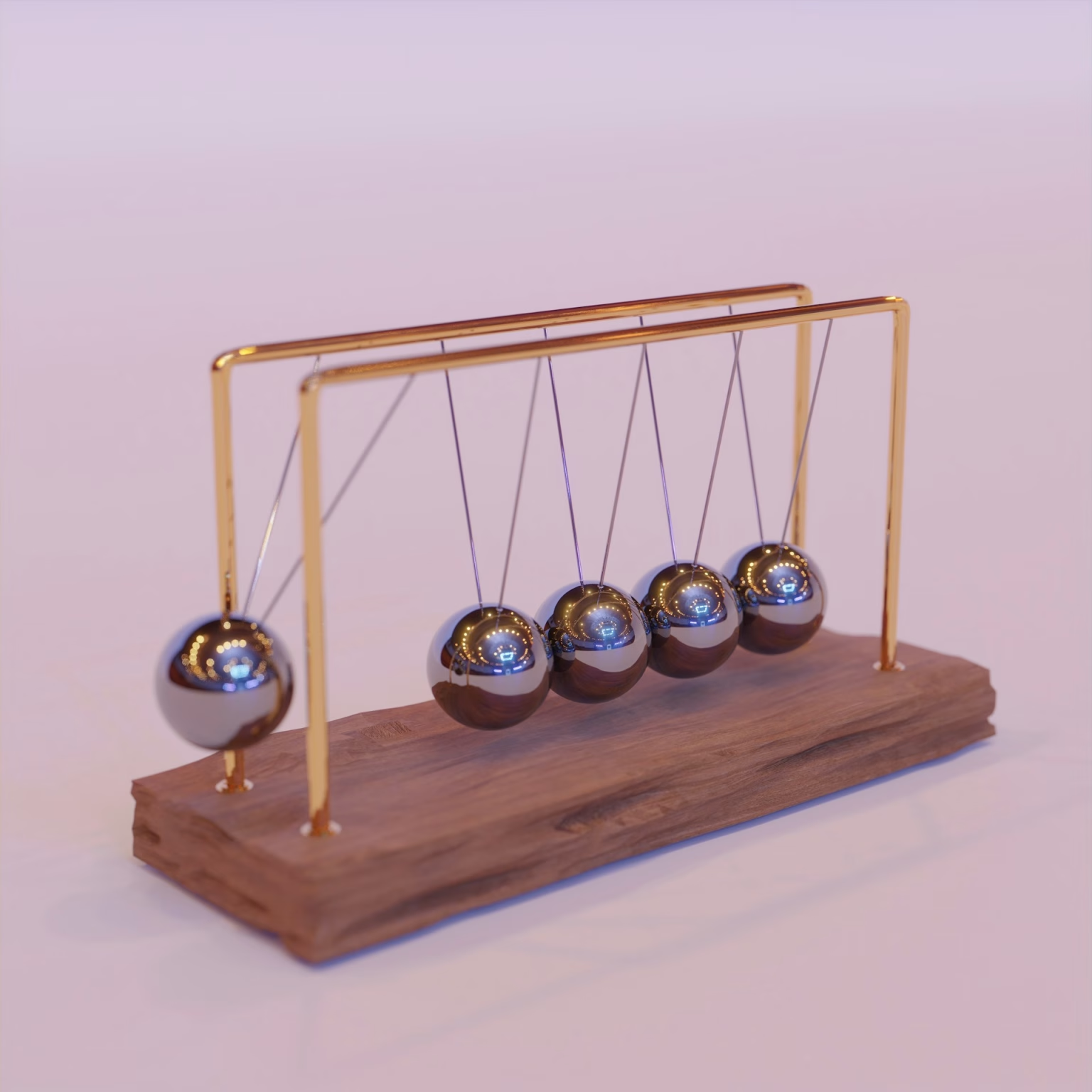

No es una metáfora. La mayoría de avances recientes en IA no se entienden sin una herramienta que Isaac Newton ayudó a consolidar hace más de tres siglos: el cálculo. En 2026 la tecnología parece nueva, pero el motor profundo sigue siendo clásico.

Newton no inventó la IA, pero sí el lenguaje que la hace posible

Newton es recordado por la gravitación universal. Sin embargo, su desarrollo del cálculo, en paralelo a Leibniz, dejó una herencia que atraviesa siglos. El cálculo permite describir cambios y encontrar óptimos.

Plantea preguntas muy concretas:

- ¿Cómo cambia una variable cuando otra se modifica?

- ¿Qué valor maximiza o minimiza un resultado?

- ¿Cuál es la trayectoria más eficiente dentro de un sistema complejo?

Esas preguntas son exactamente las que un modelo de IA responde durante su entrenamiento.

Entrenar una IA es un problema matemático de optimización

El aprendizaje automático tiene una lógica sencilla en apariencia. Se introduce información, el modelo genera una respuesta, se compara con la respuesta correcta y se calcula un error. Después se ajusta el modelo para reducir ese error.

Ahí entra el cálculo. El entrenamiento consiste en minimizar una función de pérdida. Esa función mide cuánto se equivoca el sistema.

El método más conocido es el descenso por gradiente. La analogía es simple: si estás en una montaña y quieres bajar al punto más bajo, observas hacia dónde cae más la pendiente y avanzas en esa dirección. Esa pendiente se calcula con derivadas.

Sin derivadas, entrenar modelos con millones o miles de millones de parámetros sería inviable.

Derivadas y gradientes: el ajuste fino de millones de parámetros

Una derivada indica cómo cambia algo. En IA, ese “algo” suele ser el error del modelo respecto a los datos.

Cada parámetro del sistema debe ajustarse ligeramente para mejorar el resultado global. El gradiente indica hacia dónde mover cada uno de esos parámetros. Es un proceso repetitivo y masivo:

- Definir una función objetivo

- Calcular el gradiente

- Ajustar parámetros

- Repetir millones de veces

Cuando un modelo genera texto coherente, detrás hay miles de millones de microajustes guiados por cálculo diferencial.

El salto moderno no fue conceptual. Fue industrial. Más datos, más potencia de cálculo y arquitecturas que escalan mejor.

Probabilidad y estadística: aprender patrones bajo incertidumbre

Optimizar es una parte del problema. Generalizar es la otra.

Un modelo no memoriza el mundo. Aprende patrones. Para eso necesita probabilidad y estadística. Cuando predice la siguiente palabra en una frase, calcula distribuciones de probabilidad.

Un ejemplo sencillo: al escribir “Buenos días, ¿cómo…?”, el modelo estima qué palabra tiene mayor probabilidad de aparecer después. Ese cálculo es estadístico.

La probabilidad permite:

- Medir la fiabilidad de resultados

- Detectar sobreajuste

- Evaluar rendimiento con métricas comparables

- Tomar decisiones bajo incertidumbre

La IA moderna es, en gran parte, estadística aplicada a gran escala.

Álgebra lineal: la infraestructura invisible

Hay un tercer bloque que rara vez aparece en titulares: el álgebra lineal.

Los modelos trabajan con vectores y matrices. Las palabras se transforman en representaciones numéricas dentro de espacios de alta dimensión. Cada operación interna es una multiplicación de matrices.

Esto explica algo muy concreto: las GPUs son clave porque están optimizadas para realizar millones de multiplicaciones matriciales por segundo.

Cuando un modelo procesa una frase, está realizando una cascada de operaciones algebraicas en espacios de miles de dimensiones. El proceso parece mágico desde fuera. Matemáticamente es sistemático.

La IA parece ruptura, pero es continuidad

La inteligencia artificial actual impacta porque su escala es inédita. Sin embargo, sus fundamentos llevan décadas e incluso siglos sobre la mesa.

Lo que ha cambiado:

- Modelos con más parámetros

- Conjuntos de datos masivos

- Infraestructuras capaces de entrenar durante semanas

- Mejoras técnicas acumulativas

Las bases siguen siendo cálculo, probabilidad y álgebra lineal. La novedad está en el tamaño del sistema y en su aplicación práctica.

Por qué esto importa ahora

Los grandes retos actuales de la IA no se resolverán solo con más datos. Problemas como el coste energético, la fiabilidad, la robustez o la explicabilidad requieren mejores formulaciones matemáticas.

El próximo salto puede no venir de modelos más grandes, sino de modelos mejor diseñados desde el punto de vista matemático. Nuevos métodos de optimización, nuevas aproximaciones probabilísticas o técnicas más eficientes pueden cambiar el tablero.

Cuando la tecnología madura, las matemáticas vuelven al centro.

Un hilo que conecta siglos

Newton no imaginó modelos generando texto o imágenes. Pero ayudó a construir el lenguaje matemático que permite a una máquina aprender ajustándose a un objetivo.

La historia de la IA también es la historia de cómo convertimos problemas difusos en problemas optimizables. Mientras la atención pública se centra en interfaces y productos, la ventaja competitiva suele estar en quien domina los fundamentos.

La inteligencia artificial puede ser el fenómeno tecnológico del presente, pero su base sigue siendo profundamente clásica. Y eso no parece cambiar a corto plazo.