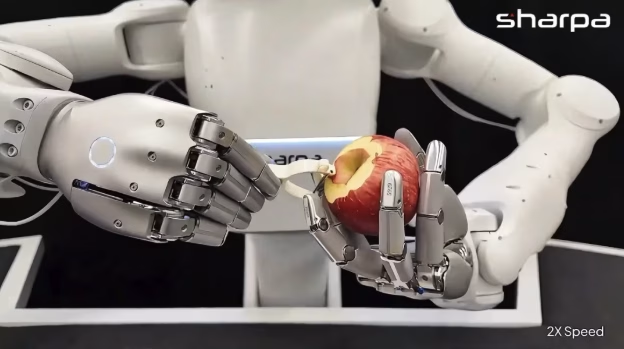

Sharpa Robotics ha presentado nuevos resultados que apuntan a un avance concreto en la manipulación bimanual de robots humanoides, un campo que lleva años frenando su salto fuera del laboratorio. El experimento gira en torno a una tarea cotidiana: pelar una manzana. Simple para una persona, pero exigente para una máquina.

La dificultad no está en el gesto, sino en la coordinación. Una mano debe sujetar y girar la fruta sin que resbale, mientras la otra guía el pelador con la presión justa. Demasiada fuerza arruina la pieza; muy poca, no corta. Es un equilibrio continuo basado en el tacto.

Para abordar este problema, la compañía combina dos elementos: la arquitectura MoDE-VLA y el sistema de entrenamiento compartido IMCopilot. Durante la fase de aprendizaje, el control no es completamente humano ni completamente automático. Se reparte.

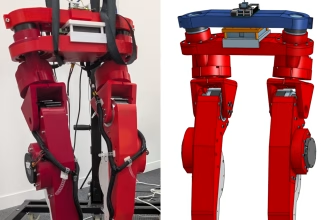

- El operador dirige los movimientos generales con un exoesqueleto.

- El robot ajusta la manipulación fina, como el giro preciso de la manzana.

Este esquema reduce la carga cognitiva de quien controla el sistema. Manejar directamente un robot con 63 grados de libertad no es práctico, ni siquiera para perfiles expertos.

El proceso se apoya además en un entorno de realidad virtual que permite al operador ver y “sentir” lo que ocurre. No es solo imagen: incluye información táctil que ayuda a decidir cuándo intervenir y cuándo dejar actuar al sistema. Un ejemplo concreto es el momento en que la cuchilla toca la piel de la fruta, donde el margen de error es mínimo.

Con estos datos, el robot pasa a operar de forma autónoma mediante MoDE-VLA. Este modelo organiza el comportamiento en módulos especializados que se activan según la fase de la tarea. No trata igual el inicio del contacto que el movimiento continuo del pelado.

El punto clave está en cómo se procesa el tacto. En lugar de mezclarlo sin más con la visión, el sistema lo gestiona por una vía específica. Así puede reaccionar con mayor precisión en situaciones donde el contacto físico lo cambia todo, como cuando la superficie es irregular o resbaladiza.

Las pruebas se realizaron en cuatro tareas con contacto directo:

- Pelado de manzana

- Ensamblaje de engranajes

- Reorganización de tubos

- Conexión de cargadores

El resultado medio fue una tasa de éxito del 34%, más del doble que el modelo base.

En el caso del pelado, el dato es más matizado. El robot completó la tarea en el 30% de los intentos. Puede parecer bajo, pero el modelo anterior no lograba terminar ninguno. Además, el sistema alcanzó un 73% en el índice de pelado, lo que indica que mantiene la secuencia durante buena parte del proceso aunque no siempre llegue al final.

¿Es suficiente para pensar en robots en casa? Todavía no. Pero sí marca una dirección clara.

El trabajo apunta a una estructura en dos niveles: por un lado, modelos que planifican a alto nivel usando visión y lenguaje; por otro, respuestas rápidas y específicas entrenadas para resolver el contacto físico en tiempo real. Esa combinación intenta acercar el comportamiento robótico al humano.

Sharpa tiene previsto mostrar su plataforma en el evento NVIDIA GTC. Mientras tanto, el sector sigue midiendo su progreso con pruebas como esta. Manipular objetos frágiles, irregulares y cotidianos, como una simple manzana, sigue siendo uno de los filtros más exigentes para evaluar hasta dónde puede llegar la robótica en entornos domésticos.