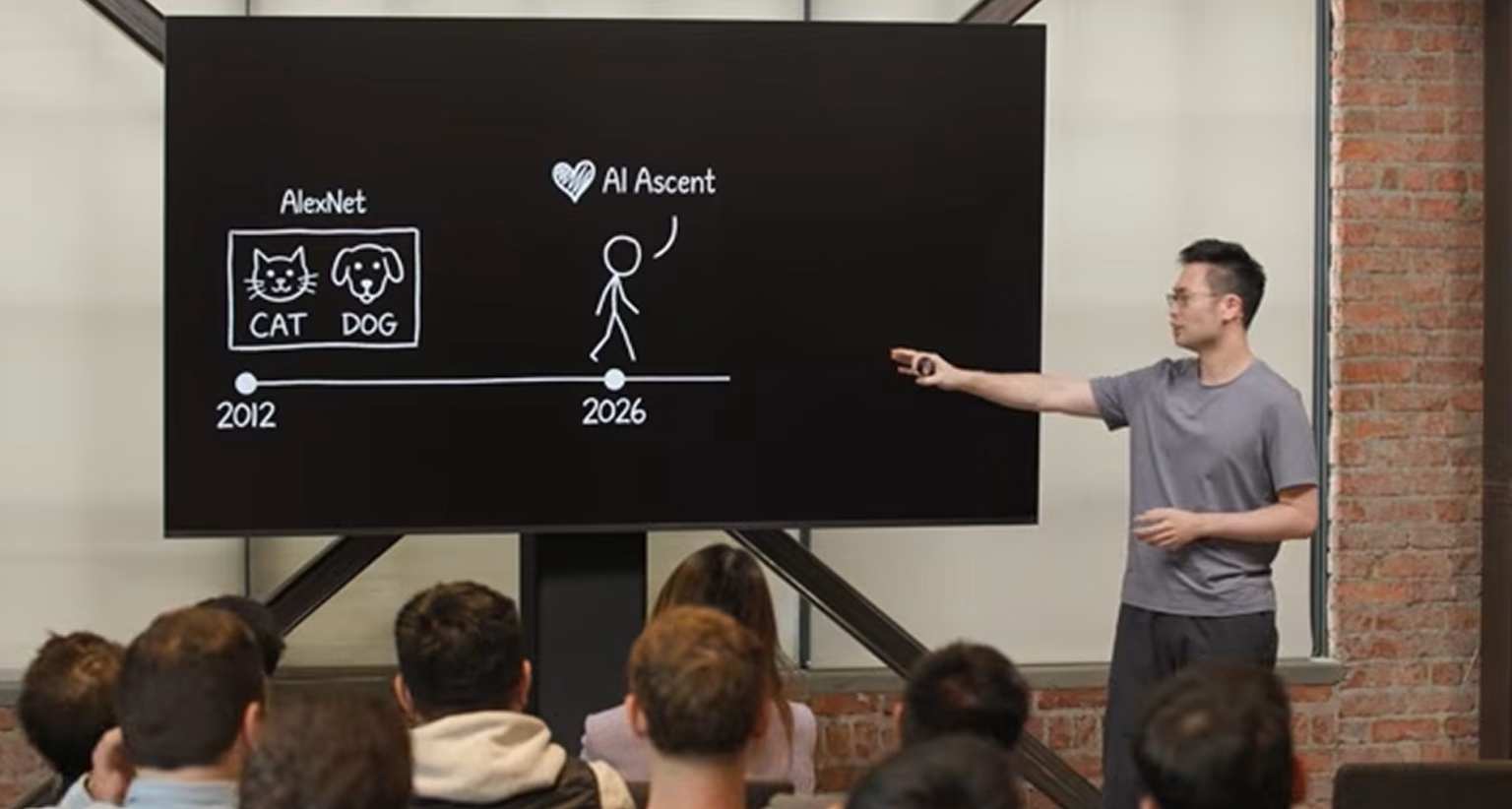

La robótica vive un momento que recuerda cada vez más a la explosión de la inteligencia artificial generativa. Esa es la idea que defendió Jim Fan, responsable del grupo de Investigación Autónoma Integrada de NVIDIA, durante el evento AI Ascent 2026 organizado por Sequoia Capital. Allí aseguró que el objetivo final de la robótica ya no pertenece al terreno de la ciencia ficción, sino que empieza a tener una hoja de ruta técnica concreta.

Según Fan, el sector atraviesa lo que definió como el “Gran Paralelismo”. La evolución de los robots estaría siguiendo un camino muy parecido al que recorrieron los grandes modelos de lenguaje como ChatGPT o Gemini. La diferencia es que ahora el foco no está en generar texto, sino en lograr que las máquinas entiendan y actúen en el mundo físico.

El investigador explicó que este desarrollo se divide en cuatro etapas: preentrenamiento, alineación, razonamiento e investigación autónoma. Son las mismas fases que han impulsado el avance de la IA generativa en los últimos años. La gran pregunta es evidente: ¿pueden los robots evolucionar al mismo ritmo que los modelos de lenguaje?

El problema de los robots que entienden objetos, pero no acciones

Durante buena parte de los últimos años, la industria apostó por modelos conocidos como VLA, siglas de Visión, Lenguaje y Acción. Ejemplos como GR00T N1.5 o π0.7 buscaban combinar comprensión visual y capacidad motora en un mismo sistema.

Fan considera que esa arquitectura empieza a mostrar límites claros. Según explicó, muchos de estos modelos funcionan como un gran modelo lingüístico al que se le añade una “capa de acción”. El resultado es eficaz para identificar objetos o interpretar escenas, pero todavía presenta dificultades cuando debe ejecutar movimientos complejos en entornos reales.

Reconocer una lata de refresco sobre una mesa es relativamente sencillo. Manipularla correctamente sin derramarla sigue siendo otro desafío.

Para resolver ese problema, NVIDIA está impulsando un nuevo enfoque: los llamados Modelos de Acción Mundial o WAM. En lugar de limitarse a predecir texto o instrucciones, estos sistemas intentan anticipar cómo evolucionará el entorno físico en el siguiente instante.

El ejemplo que puso Fan fue DreamZero, un proyecto de NVIDIA que trabaja con esa lógica. El modelo “imagina” futuros estados físicos prediciendo simultáneamente imágenes y movimientos articulares. Es decir, no solo interpreta lo que ve el robot, también calcula cómo debería reaccionar el cuerpo mecánico.

Fan relacionó este avance con modelos de vídeo generativo como Sora o Veo. Según explicó, estas plataformas ya muestran indicios de comprender conceptos físicos complejos como gravedad, reflejos o flotabilidad únicamente gracias a la escala de entrenamiento.

NVIDIA quiere dejar atrás la teleoperación

Uno de los momentos más llamativos de la intervención llegó cuando Fan dedicó un simbólico “minuto de silencio” a la teleoperación. Durante años, este método ha sido clave para entrenar robots: un humano controla remotamente una máquina y genera datos de movimiento que luego sirven para el aprendizaje automático.

El problema es la escala. Un operador humano tiene límites físicos, horarios y costes imposibles de multiplicar al ritmo que exige la nueva generación de robots.

Por eso, NVIDIA está apostando por otro tipo de recopilación de datos basada directamente en movimientos humanos reales mediante sensores y sistemas portátiles.

Entre las tecnologías destacadas aparecen:

- Interfaces UMI que se colocan en las manos humanas para capturar movimientos sin necesidad de controlar un robot.

- Sistemas de vídeo egocéntrico en primera persona para entrenar modelos motores.

- Grandes bases de datos de comportamiento humano grabadas durante miles de horas.

Uno de los proyectos mencionados fue EgoScale, entrenado con más de 20.000 horas de vídeo humano. Según Fan, la investigación mostró una relación casi perfecta entre cantidad de datos y mejora de la destreza robótica.

La conclusión de NVIDIA es contundente: la teleoperación pasará a representar una parte mínima del entrenamiento total de los robots avanzados.

El nuevo objetivo: entrenar robots dentro de sueños digitales

Otro de los conceptos centrales de la presentación fue la llamada “Simulación 2.0”. NVIDIA quiere reducir la dependencia del mundo físico creando entornos virtuales cada vez más realistas donde los robots puedan entrenarse millones de veces sin desgaste ni costes reales.

Fan habló de “primos digitales”, espacios generados a partir de escaneos realizados incluso con un iPhone. Pero el proyecto más ambicioso es DreamDojo, un simulador neuronal que sustituye parte de las ecuaciones clásicas de la física por generación de vídeo basada en datos.

La idea es simple de explicar y compleja de ejecutar: el robot aprende dentro de un entorno generado por IA que evoluciona continuamente como si fuera un sueño digital.

Si el sistema funciona, el entrenamiento podría acelerarse de forma radical. Un robot podría practicar miles de escenarios en muy poco tiempo, desde abrir puertas hasta manipular herramientas delicadas o moverse por fábricas enteras.

Fan resumió esta visión con una frase que marcó buena parte de la conferencia: “la computación equivale al entorno y el entorno equivale a los datos”.

La fecha que NVIDIA pone a la robótica avanzada

La parte más ambiciosa de la ponencia llegó al final. Jim Fan aseguró que la llamada “Prueba de Turing Física” podría superarse en apenas dos o tres años. Se refiere al momento en el que un robot sea capaz de realizar tareas físicas con una destreza indistinguible de la humana.

Más allá de ese horizonte inmediato, el investigador proyectó un escenario todavía más disruptivo para 2040. Según su visión, los robots no solo ejecutarán tareas, también serán capaces de diseñar y mejorar nuevas generaciones de máquinas de manera autónoma.

La industria tecnológica lleva años hablando de inteligencia artificial general. NVIDIA empieza ahora a hablar de robótica generalista.

Fan cerró su intervención con una reflexión que resume el momento que atraviesa el sector. Dijo que la humanidad nació demasiado tarde para explorar la Tierra y demasiado pronto para explorar las estrellas, pero justo a tiempo para resolver los grandes problemas de la robótica.