Cambiar de herramienta de IA cuesta. No por pereza, sino porque detrás hay tiempo invertido. Horas explicando cómo trabajas, qué tono prefieres, qué necesitas en tu día a día. Todo eso crea una especie de memoria compartida. Y pensar en perderla al usar otra herramienta nos echa para atrás.

Eso es justo lo que intenta resolver ahora Anthropic. La empresa ha lanzado una forma sencilla de llevar “tu memoria” de ChatGPT a su modelo Claude. Según han explicado, basta con copiar y pegar la información para que el nuevo sistema tenga el mismo contexto que ya habías construido. No hay que empezar desde cero ni volver a explicar quién eres o cómo trabajas.

Cómo se hace, paso a paso

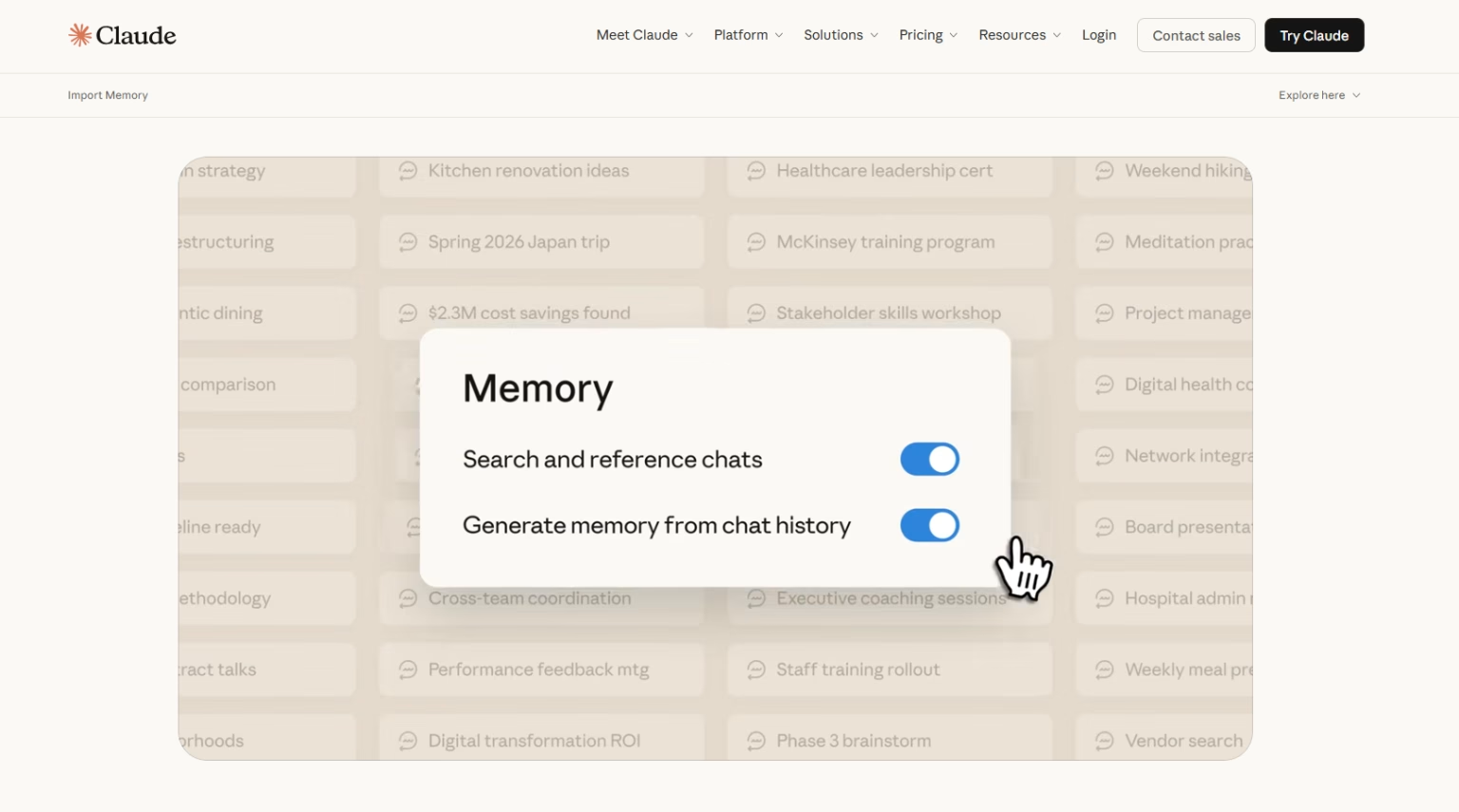

La propia empresa te da un texto preparado. Lo copias y lo pegas en el chat de la inteligencia artificial que usas ahora, por ejemplo ChatGPT. Ese texto hace que el sistema junte en una sola respuesta todo lo importante sobre ti: tu estilo, tus preferencias y tu forma de trabajar. Cuando te dé esa respuesta, la copias y la pegas en la parte de memoria de Claude. No hay que descargar nada ni tocar configuraciones complicadas. En pocos minutos, la nueva herramienta ya tiene tu contexto. Es algo muy básico. Copiar y pegar.

Que no se sienta como empezar otra vez

Claude puede guardar tus preferencias y tener en cuenta cómo trabajas. Además, mantiene los temas separados para que un proyecto no se mezcle con otro. Y si algo no te gusta, puedes revisar lo que recuerda y cambiarlo.

Esta función está dentro de su plan de pago, pensado para quienes usan la herramienta de forma habitual. La intención es que el primer día usando Claude no se sienta como un comienzo desde cero, sino como una continuidad natural de lo que ya venías haciendo.

Y si la posibilidad de traspasar la memoria de la herramienta de IA que usas no es suficiente motivo para pensar en cambiarte a Claude,hay más razones por las que algunas personas lo están haciendo.Una tiene que ver con la confianza: BullshitBench ha mostrado que las versionesrecientes de Claude tienden a rechazar afirmaciones sin sentido en la mayoría de los casos, mientras que otros modelos pueden aceptar más contenido incorrecto.

La otra razón tiene que ver más con principios y valores. Anthropic decidió no aceptar ciertos usos militares de su tecnología si no podía poner sus propias reglas de seguridad, mientras OpenAI sí cerró ese acuerdo. Para muchos, esa forma de actuar también cuenta a la hora de elegir con qué herramienta quedarse.