OpenAI ha dado un paso que va más allá de una simple actualización de producto. Con el lanzamiento de ChatGPT Health, la compañía reconoce de forma explícita algo que ya estaba ocurriendo: millones de personas usan la inteligencia artificial para resolver dudas médicas. Según datos de la propia empresa, unos 230 millones de usuarios consultan cada semana cuestiones relacionadas con salud y bienestar. Ignorar ese uso ya no era una opción.

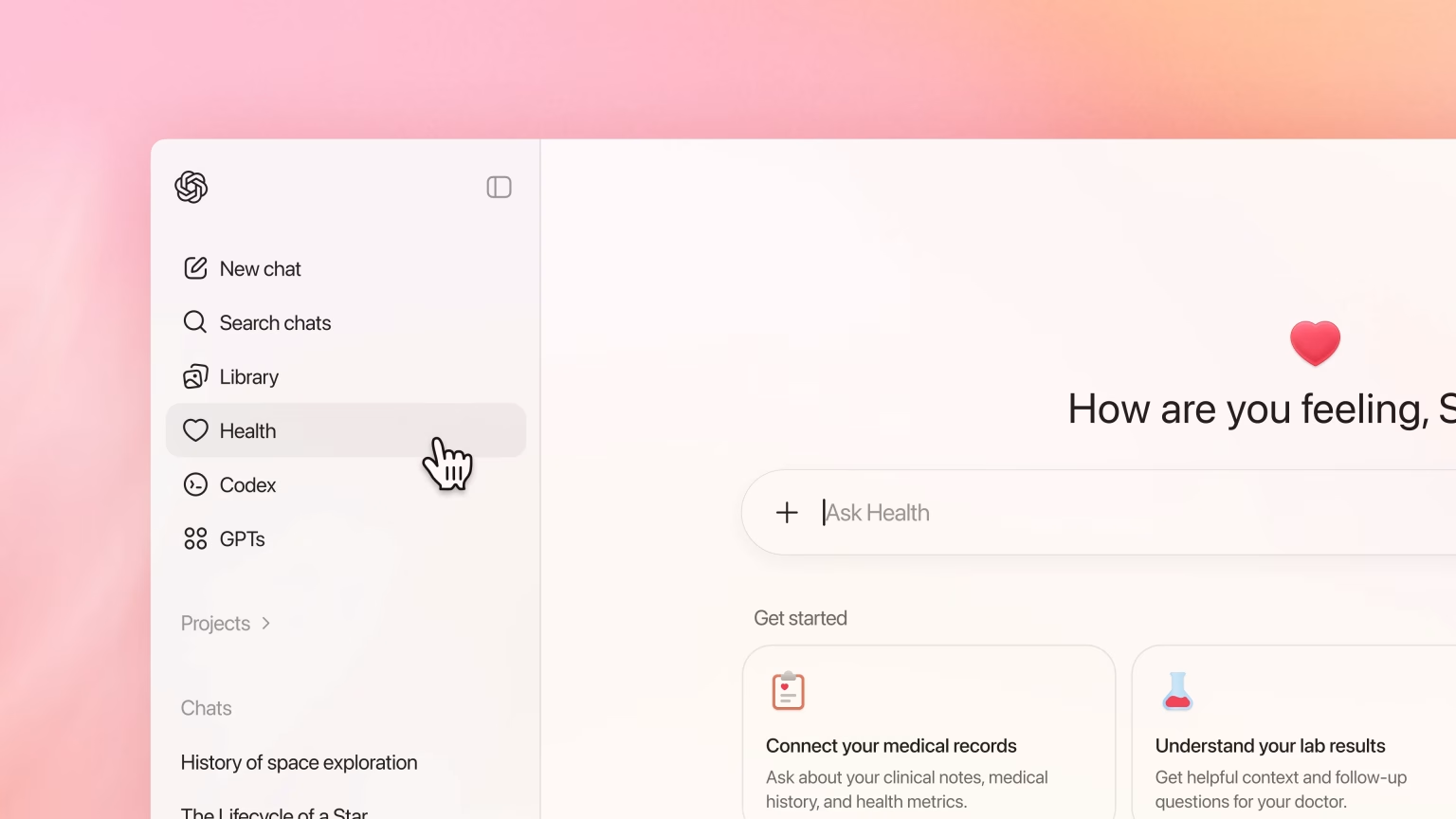

La novedad no está solo en el nombre. ChatGPT Health nace como un espacio separado del resto de conversaciones, diseñado para aislar información sensible y ofrecer un marco más claro al usuario. La idea es sencilla: hablar de síntomas, hábitos o preocupaciones médicas no debería mezclarse con chats de trabajo, ocio o tareas cotidianas. ¿Es suficiente para cambiar el fondo del problema? Ahí empieza el debate.

Un entorno separado para algo que ya ocurría

Hasta ahora, las consultas médicas convivían con el resto de interacciones. El nuevo enfoque introduce una barrera funcional: si el sistema detecta que una pregunta tiene que ver con salud y se formula fuera de este entorno, intenta redirigirla a ChatGPT Health. No es un bloqueo, pero sí una señal clara de contexto.

OpenAI defiende que este aislamiento mejora el control del usuario. La información de salud no se arrastra a otros chats y queda concentrada en un único espacio. Aun así, el sistema puede usar contexto previo relevante, siempre que el usuario lo haya compartido. Por ejemplo, saber que alguien entrena para una maratón puede influir en recomendaciones generales sobre descanso o nutrición dentro del apartado de salud.

La empresa insiste en un punto clave: las conversaciones de ChatGPT Health no se usarán para entrenar modelos. En un momento de creciente sensibilidad sobre datos personales, este mensaje no es menor.

Integración con apps y seguimiento personal

Otro de los movimientos relevantes es la apertura a integraciones con aplicaciones de bienestar. Plataformas de actividad física, nutrición o seguimiento de hábitos pueden aportar datos para contextualizar respuestas. Un ejemplo práctico: registrar actividad diaria y usarla para hablar de objetivos de descanso o rutina física, sin necesidad de repetir información en cada consulta.

Este enfoque apunta a un uso continuado, no puntual. ChatGPT Health no se presenta como una herramienta para “buscar un síntoma”, sino como un espacio de acompañamiento informativo. No diagnostica, no receta, pero ayuda a entender mejor qué preguntar y cuándo acudir a un profesional.

Una respuesta a un sistema sanitario saturado

OpenAI enmarca el lanzamiento en un problema estructural: el acceso a la atención sanitaria. Listas de espera, consultas breves y seguimiento fragmentado son realidades comunes en muchos países. ChatGPT Health pretende ocupar un hueco intermedio: orientación, educación y apoyo informativo.

La advertencia legal se mantiene sin cambios. ChatGPT no sustituye a un médico y no está diseñado para diagnosticar ni tratar enfermedades. La diferencia ahora es que ese mensaje llega en un entorno específico, no diluido entre otros usos.

Organismos internacionales como la Organización Mundial de la Salud llevan tiempo señalando el potencial de la IA para apoyar sistemas sanitarios, siempre que exista supervisión y límites claros.

Riesgos conocidos, ahora más visibles

El problema de fondo no desaparece. Los modelos de lenguaje no verifican clínicamente la información: generan respuestas probables. Esto abre la puerta a errores, simplificaciones o recomendaciones inadecuadas si el usuario no contrasta fuentes.

Centralizar las consultas puede ayudar a ordenar expectativas, pero no elimina el riesgo. De hecho, lo hace más visible. ChatGPT Health no amplía el alcance médico de la IA; reconoce y estructura un uso que ya estaba desbordando los límites iniciales del producto.

Qué cambia realmente con ChatGPT Health

Más que una revolución, el lanzamiento supone un reconocimiento explícito. OpenAI acepta que su asistente ya forma parte del recorrido informativo de millones de personas en temas de salud. Al crear un espacio específico:

- Separa información sensible del resto de usos.

- Refuerza mensajes de límites y responsabilidad.

- Facilita integraciones futuras con apps de bienestar.

- Reduce el riesgo de malentendidos sobre el alcance médico.

ChatGPT Health no convierte a OpenAI en un actor sanitario, pero sí en algo nuevo: un intermediario informativo estructurado en salud. El reto no será tecnológico, sino de confianza. Y esa, como siempre, se gana con límites claros y uso responsable.