La llegada de navegadores con agentes de inteligencia artificial promete cambiar la forma en que interactuamos con la web. Automatizan tareas, leen correos, rellenan formularios y toman decisiones en nombre del usuario. Pero ese salto en autonomía tiene un precio. OpenAI ha reconocido públicamente que los ataques de inyección de prompts seguirán siendo un problema estructural, incluso con mejoras constantes de seguridad.

La advertencia no es menor. En una publicación reciente, la compañía admite que estas técnicas, que consisten en ocultar instrucciones maliciosas dentro de textos aparentemente inofensivos, son difíciles de erradicar por completo. El paralelismo que traza OpenAI es claro: igual que nunca se eliminaron del todo el phishing o la ingeniería social, los agentes de IA convivirán con este riesgo de forma permanente.

Qué es la inyección de prompts y por qué importa ahora

La inyección de prompts aprovecha una debilidad básica de los modelos de lenguaje: leen y obedecen texto. Un correo electrónico, una web o incluso un documento pueden incluir frases diseñadas para alterar el comportamiento del agente. Por ejemplo, instrucciones ocultas que indiquen al sistema que ignore reglas previas, que extraiga información sensible o que ejecute acciones no deseadas.

Hasta hace poco, este riesgo se limitaba a chats o APIs. El problema cambia de escala cuando entra en juego un navegador con modo agente. ChatGPT Atlas, lanzado en octubre, puede navegar por la web, interactuar con servicios y acceder a datos del usuario. Eso amplía de forma notable la superficie de ataque.

Desde el primer día, investigadores de seguridad demostraron que bastaban párrafos camuflados en texto legítimo para modificar su comportamiento. No es un caso aislado. Anthropic y Google han reconocido en distintos informes que este tipo de ataques forman parte del coste inherente a los sistemas de IA autónomos.

Un riesgo que también preocupa a los gobiernos

La inquietud no se limita a las empresas tecnológicas. El Centro Nacional de Ciberseguridad del Reino Unido ha sido explícito: las inyecciones de prompts “pueden no mitigarse nunca por completo”. Su recomendación es pragmática. En lugar de buscar una eliminación total, hay que reducir el impacto, detectar rápido y contener daños.

Este enfoque marca un cambio de mentalidad. La seguridad en IA deja de parecerse a un muro infranqueable y se acerca más a un sistema de defensas activas, siempre en movimiento.

Cómo intenta defenderse OpenAI

Ante este escenario, OpenAI ha optado por una estrategia agresiva de prueba y error. Uno de sus desarrollos más llamativos es un “atacante automatizado”, un modelo de lenguaje entrenado para comportarse como un hacker. Su función es simple y preocupante a la vez: intentar romper el sistema de forma constante.

Este atacante simula inyecciones de prompts en entornos controlados, analiza la reacción del agente y ajusta sus técnicas mediante aprendizaje por refuerzo. El objetivo es adelantarse a ataques reales. Según la compañía, este método ha permitido descubrir vectores que no habían aparecido en auditorías humanas ni en pruebas externas.

En una demostración interna, el sistema logró insertar instrucciones ocultas en un correo electrónico que provocaban acciones no deseadas. Tras aplicar un parche, Atlas pasó a detectar el intento y lanzar una alerta. Es un avance, pero no una solución definitiva.

Autonomía frente a control: el verdadero dilema

Para muchos expertos, el problema de fondo no es solo técnico. Rami McCarthy, investigador principal en la firma de ciberseguridad Wiz, resume el riesgo en una ecuación clara: autonomía más acceso igual a peligro. Los navegadores con agentes combinan ambas cosas.

Pueden actuar sin supervisión constante y, al mismo tiempo, acceder a correos, mensajes, historiales de navegación o datos de pago. En ese contexto, una instrucción maliciosa bien diseñada puede tener consecuencias reales.

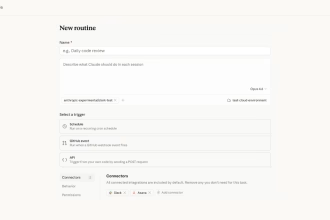

OpenAI reconoce esta tensión y recomienda varias medidas prácticas:

- Limitar el acceso de los agentes a datos sensibles

- Exigir confirmaciones explícitas antes de acciones críticas

- Usar instrucciones concretas y acotadas, no órdenes amplias

Estas barreras reducen el impacto de un ataque, pero no lo eliminan. La propia compañía admite que no existen garantías absolutas.

Aceptar el riesgo como parte del sistema

La conclusión que empieza a imponerse en el sector es incómoda, pero realista. Los navegadores con IA serán herramientas poderosas, productivas y cada vez más comunes. Y también serán objetivos permanentes de nuevas formas de ataque.

El riesgo cero no es un objetivo alcanzable. La clave estará en diseñar sistemas que fallen de forma segura, que alerten a tiempo y que limiten los daños cuando algo salga mal. Igual que los usuarios aprendieron a desconfiar de ciertos correos, tendrán que aprender a convivir con agentes inteligentes que, aunque útiles, no son infalibles.

La promesa de la IA en la navegación web sigue intacta. Pero OpenAI ya ha dejado claro algo esencial: más inteligencia también significa más superficie para el error y el abuso. El reto ahora no es negarlo, sino gestionarlo.