Google ha presentado en versión preliminar Gemini 3.1 Pro, la nueva evolución de su modelo de lenguaje dentro de la familia Gemini. El sistema está disponible en modo preview y, según la compañía, se desplegará de forma general en las próximas semanas.

Gemini 3.1 Pro sucede a Gemini 3, lanzado en noviembre y ya considerado un modelo de altas capacidades. La diferencia, según observadores del sector, no es incremental. La nueva versión representa un salto relevante en rendimiento, especialmente en tareas de razonamiento complejo.

En el anuncio oficial, Google compartió resultados de benchmarks independientes. Uno de los más citados es Humanity’s Last Exam, una prueba diseñada para evaluar habilidades avanzadas de razonamiento y resolución de problemas. En esta métrica, Gemini 3.1 Pro supera con claridad las puntuaciones obtenidas por Gemini 3. No se trata solo de responder preguntas, sino de mantener coherencia en procesos largos y encadenar pasos lógicos.

Para entender el impacto, pensemos en un ejemplo práctico. Resolver un problema jurídico con múltiples cláusulas o analizar un contrato técnico de varias páginas exige mantener contexto y consistencia. En este tipo de escenarios es donde los modelos suelen fallar. Google sostiene que 3.1 Pro mejora precisamente en esa dimensión.

El modelo también ha sido evaluado en APEX, un sistema desarrollado por la startup Mercor que mide el desempeño de modelos de IA en tareas profesionales reales. Brendan Foody, consejero delegado de la compañía, indicó en redes sociales que Gemini 3.1 Pro encabeza actualmente la clasificación de APEX-Agents. Esto implica que el modelo no solo destaca en pruebas académicas, sino también en entornos que simulan trabajo práctico.

El lanzamiento se produce en un contexto de competencia acelerada. OpenAI y Anthropic han presentado en los últimos meses nuevas versiones centradas en capacidades agénticas y razonamiento en múltiples pasos. El mercado ya no se mueve por actualizaciones anuales. Las mejoras se anuncian cada pocas semanas.

En este entorno, los benchmarks se han convertido en un campo de batalla. Las compañías compiten por liderar tablas comparativas, aunque estas no siempre reflejan el rendimiento en todos los usos reales. Aun así, marcar récords en pruebas reconocidas tiene un efecto claro en percepción de liderazgo tecnológico.

Gemini 3.1 Pro apunta a consolidar la estrategia de Google de ofrecer modelos con alto rendimiento tanto en razonamiento como en tareas profesionales. La compañía busca posicionarlo como una herramienta fiable para desarrolladores, investigadores y empresas que necesiten capacidades avanzadas sin recurrir necesariamente al modelo más grande o costoso.

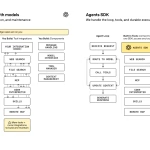

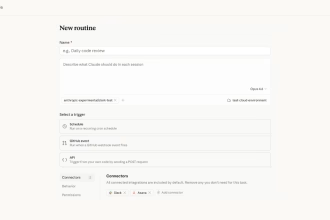

El foco actual del sector está en el trabajo agéntico, es decir, modelos capaces de planificar, ejecutar acciones y adaptarse a resultados intermedios. Si un sistema puede analizar datos, escribir código, corregir errores y continuar sin supervisión constante, su utilidad empresarial se multiplica. Google quiere jugar en ese terreno.

La pregunta es inevitable: ¿son estos récords suficientes para inclinar la balanza en una carrera donde la ventaja dura apenas semanas? Cada nuevo lanzamiento redefine el listón. Gemini 3.1 Pro eleva ese listón una vez más.

La competencia no es solo técnica, también es narrativa. Publicar resultados sólidos en pruebas independientes refuerza la imagen de liderazgo. Pero el verdadero examen llegará en el uso cotidiano: en cómo el modelo responde a problemas reales, en empresas reales, con datos reales.

Por ahora, Google se adelanta en las métricas. La próxima jugada, como suele ocurrir en esta industria, podría llegar antes de lo esperado.