OpenAI ha anunciado nuevas medidas de seguridad en ChatGPT ante el aumento de riesgos asociados a sistemas que interactúan con la web y aplicaciones conectadas. La compañía introduce dos cambios relevantes: el denominado Lockdown Mode y un sistema de etiquetado de “Elevated Risk” para ciertas funcionalidades.

A medida que los modelos acceden a más herramientas externas, también crecen los riesgos. Uno de los más conocidos es el prompt injection, un tipo de ataque en el que un tercero intenta manipular al sistema para que ejecute instrucciones maliciosas o revele información sensible. Por ejemplo, un contenido web podría incluir texto oculto diseñado para que el modelo ignore sus reglas y extraiga datos confidenciales.

Un modo de seguridad reforzada para perfiles de alto riesgo

El Lockdown Mode es una configuración opcional orientada a usuarios con mayores necesidades de protección. Está pensado para equipos directivos, departamentos de seguridad o entornos empresariales donde la información es especialmente sensible. No es una función diseñada para el usuario medio.

Según OpenAI, este modo limita de forma determinista ciertas herramientas y capacidades que podrían ser explotadas. Uno de los cambios más relevantes afecta a la navegación web. En Lockdown Mode, el acceso se restringe a contenido almacenado en caché, lo que impide realizar solicitudes en directo fuera de la red controlada por la compañía. Si no se pueden ofrecer garantías sólidas de seguridad, determinadas funciones simplemente se desactivan.

El modo se suma a protecciones ya existentes, como:

- Uso de entornos aislados o sandboxing.

- Mecanismos frente a exfiltración de datos mediante URL.

- Sistemas de monitorización y control.

- Acceso basado en roles y registros de auditoría en entornos empresariales.

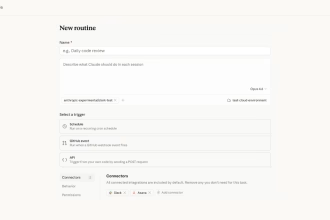

Lockdown Mode estará disponible en los planes ChatGPT Enterprise, ChatGPT Edu, ChatGPT for Healthcare y ChatGPT for Teachers. Los administradores podrán activarlo desde la configuración del espacio de trabajo creando un rol específico. Además, podrán definir con precisión qué aplicaciones y qué acciones están permitidas cuando el modo esté activo.

De forma complementaria, la plataforma de registros de la API de cumplimiento ofrece visibilidad detallada sobre el uso de aplicaciones, datos compartidos y fuentes conectadas. Esto permite auditar qué ocurrió, cuándo y con qué herramientas.

OpenAI prevé ampliar la disponibilidad de Lockdown Mode a usuarios particulares en los próximos meses.

Etiquetas para advertir sobre capacidades con mayor riesgo

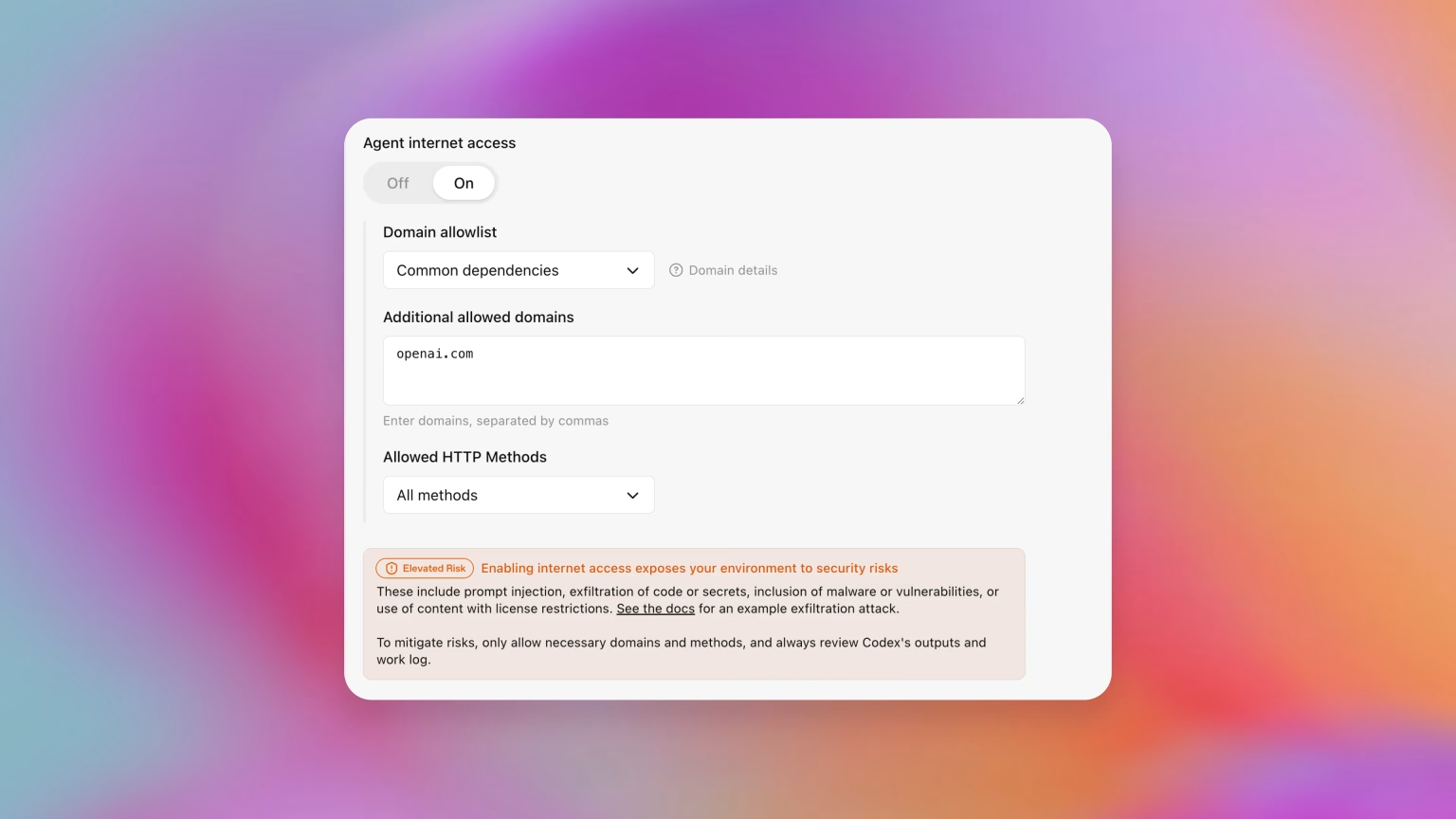

La segunda medida es la estandarización de la etiqueta “Elevated Risk”. Esta advertencia identificará funciones que pueden introducir riesgos adicionales, especialmente aquellas que implican acceso a la red o interacción con sistemas externos.

Las etiquetas aparecerán de forma consistente en ChatGPT, ChatGPT Atlas y Codex. El objetivo es ofrecer información clara antes de activar ciertas opciones. No se trata de bloquear el acceso, sino de explicar qué cambia y qué implicaciones puede tener.

En el caso de Codex, el asistente de programación, los desarrolladores pueden habilitar acceso a la red para consultar documentación en línea o ejecutar acciones externas. Esa pantalla incluirá la etiqueta de “Riesgo Elevado” junto a una explicación detallada. El usuario decide, pero con más contexto.

Seguridad como proceso continuo

OpenAI ha indicado que seguirá reforzando sus salvaguardas frente a riesgos emergentes y revisará periódicamente qué funciones mantienen la etiqueta de “Elevated Risk”. La advertencia se retirará cuando se considere que los avances en seguridad han mitigado suficientemente los riesgos para un uso generalizado.

El movimiento refleja un equilibrio delicado. Cuantas más capacidades se añaden a los sistemas conectados, mayor es su utilidad. Pero también crece la superficie de ataque. Lockdown Mode y las nuevas etiquetas apuntan a un enfoque más granular: no todos los usuarios necesitan el mismo nivel de apertura ni el mismo nivel de blindaje.